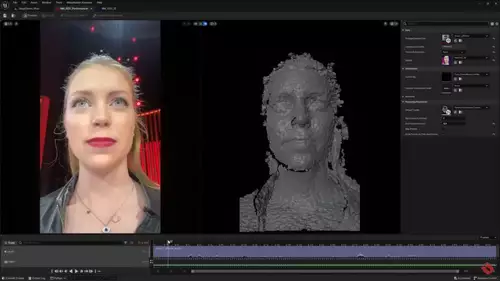

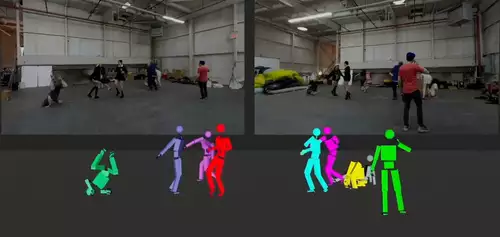

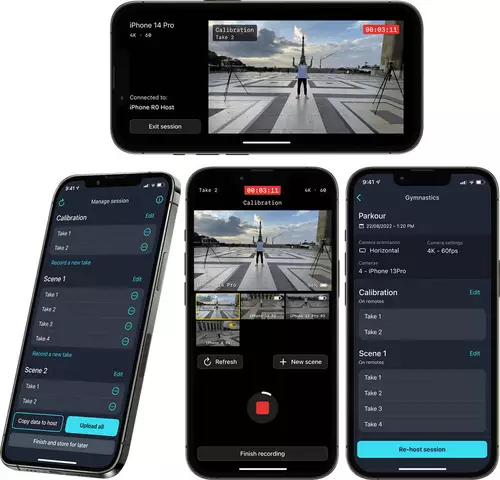

Seit kurzem ist eine iPhone-App verfügbar, Move.ai, mit welcher sich hochqualitative Motion Capturings ganz ohne Marker erstellen lassen. Um die Bewegungen einer (oder sogar mehrerer) Personen zu tracken, muss allerdings aus mehreren Perspektiven gefilmt werden. Daher werden 2 bis 6 iPhones benötigt, die via App miteinander verbunden werden.

Die Aufnahmen der verknüpften Geräte werden danach zum Move.ai Onlinedienst hochgeladen, also in der Cloud verarbeitet (genutzt wird AWS). Die fertigen Skeletons bzw. Tracking-Daten sind kompatibel mit einer Vielzahl Programme, aktuell Maya, MotionBuilder, Blender, Cinema4D, Unreal Engine, Unity und Houdini. Ausgegeben werden FBX- (Pre-/Retargeted), Blender- oder Maya HIK-Dateien. Auch die Fingerpositionen lassen sich tracken, laut Move.ai mit ca. 70% Trefferquote, während das Körpertracking zu 90% akkurat ausfällt.

Die MoCap-Aufnahme-Aufnahme läßt sich sehr einfach durchführen. Die filmenden iPhones müssen lediglich auf Stativen o.ä. befestigt sein und die zu trackende Person immer komplett im Bild haben. Je mehr Kameras verwendet werden, umso genauer kann getrackt werden, da sich Occlusionen (Überdeckungen) besser ausgleichen lassen. Es empfiehlt sich, bei der Wahl der Kleidung auf ausreichend Kontrast zum Hintergrund zu achten (allerdings ist schwarz ungünstig), auch sollte sie eher eng sein, siehe Help-Dokumente.

// Top-News auf einen Blick:

- Blackmagic DaVinci Resolve 20 Beta 2 bringt neue Funktionen und Bugfixes

- Blackmagic Camera for Android 2.1 bringt neue Features

- Neuer superschneller PoX Flash-Speicher könnte DRAM und SSDs ersetzen

- Achtung: Verpixelte Videos können wieder kenntlich gemacht werden

- KI-generierte Fake-Trailer: Wie Hollywood an der Irreführung der Zuschauer ...

- Beleuchtung für Foto und Video lernen mit kostenlosem Tool von Google

Vor der Aufnahme muss eine Kalibrierung vorgenommen werden und auch zu Beginn jedes Takes müssen die Personen im Bild einige vordefinierte Aktionen machen, damit das Tracking funktioniert (in die Hände klatschen für den Sync und dann 2s mit den Armen in T-Positon stehen). Aktuell lassen sich mit Move.ai nur Menschen tracken (keine Tiere); an Objekten werden ferner nur (Fuss-)Bälle erkannt.

Als Webservice steht Move.ai bereits seit ein paar Jahren zur Verfügung, neu ist nun die iPhone-App - unterstützt werden die Modelle iPhone 8 - 14 mit iOS 16+. Wie der Name schon verrät, basiert die Anwendung auf KI-Algorithmen bzw. eine Kombination aus Maschinensehen und Deep Learning. So läßt sich auf umständliche MoCap-Workflows mit Tracking-Suits uä. verzichten.

Wer sich bei Move.ai anmeldet, bekommt zwei Gratis-Minuten Motion Capturing geschenkt, daher läßt sich das Tracking kostenlos ausprobieren. Nach Ablauf der Freiminuten kostet das Verarbeiten der Capturings 365 Dollar für 12 Monate. Allerdings gibt es keine MoCap-Flatrate, sondern wer mehr als 30 Minuten per Monat (oder 6 Stunden pro 6 Monate) verarbeiten möchte, muss zusätzlich 4 Cent pro Minute bezahlen.