Videos lassen sich leicht per KI erzeugen und auf YouTube hochladen, aber möchte man damit Geld verdienen, müssen sie möglichst oft gesehen werden. Wie aber erreicht man inmitten einer Flut anderer KI-Clips genügend Aufmerksamkeit für den eigenen Clip? Einige YouTuber haben das Rezept gefunden, per Video-KI auf YouTube genügend Aufrufe und damit auch Geld zu generieren: Sie erzeugen Fake-Filmtrailer für kommende Hollywood-Blockbuster. Diese werden von YouTube-Besuchern oft gesucht und bekommen aufgrund der Bekanntheit der Filme, auf denen sie basieren (oftmals Sequels und Prequels schon erfolgreicher Filme), viel Aufmerksamkeit und Views. YouTube-Kanäle wie KHStudio und ScreenCulture bekommen Milliarden von Views und Millionen an Einnahmen für ihre Fake-Trailer, die zum Teil von Firmen produziert werden, welche ein Dutzend Editoren beschäftigen, die alle paar Tage einen neuen Trailer veröffentlichen.

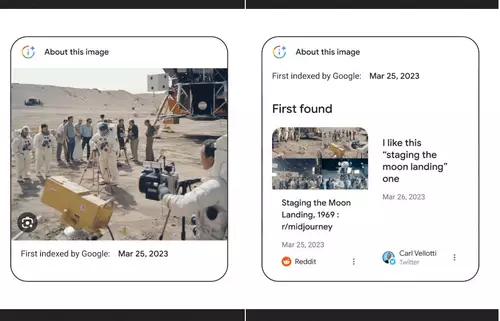

Und da viele User den typischen Look von KI-erzeugten Videos nicht erkennen, halten sie die Trailer für echt. Dank der Möglichkeit, die Gesichter der echten Schauspieler in die Trailer einzuarbeiten, sehen diese offensichtlich realistisch genug aus. Die Öffentlichkeit scheint weitestgehend unvorbereitet auf die Content-Apokalypse per KI im Netz. Manche Zuschauer wiederum wissen, dass es sich um Fakes handelt, und erfreuen sich an dem Spiel um die spektakulären Neubesetzungen von Filmen.

Bevor KI-Tools zugänglich wurden, war die Produktion solcher Fakes nur unter relativ großem Aufwand möglich, jetzt ist diese ein Kinderspiel: Die echten Schauspieler, exotische Schauplätze und eine extravagante Ausstattung all das generieren Video-KIs schnell und einfach per Prompt. Manchmal erscheinen Fake-Trailer weit vor den offiziellen Trailern von kommenden Filmen, manchmal erst später und verwenden dann sogar Sequenzen der echten Trailer. Oft aber verkünden die Trailer selbst Fortsetzungen populärer Filme oder auch Spielen, die gar nicht vorgesehen sind Hauptsache, die vorgestellten Filmprojekte sind einigermaßen glaubwürdig. So gibt es Trailer von "Titanic 2", "Pirates of the Caribbean 6", "Legend of Zelda", "Squid Game 3" mit Leonardo DiCaprio oder auch "Bond 26" mit der Neubesetzung von Henry Cavill als James Bond und Margot Robbie als Bondgirl dank KI sind der Fantasie keine Grenzen gesetzt. Hunderttausende von Views erreichen diese Trailer, vor allem wenn sie vor den offiziellen Trailern auf YouTube erscheinen sie spielen in der Welt des jeweiligen Films, zeigen die "echten" Schauspieler, spektakuläre Bilder, aber wirken doch meist nur wie aneinandergereihte Bewegtbildchen im typischen KI-Look.

Wer sich mit Video-KIs auskennt, wird beim Anschauen der Clips schnell misstrauisch, denn der typische KI-Look (samt KI-Stimme) ist leicht erkennbar: Die Gesichter sind flach, die Kamerabewegungen stereotypisch und über allem schwebt eine gewisse Leere der Bilder und der Erzählung, die keine Lust auf den ganzen Film macht.

Erleichtert werden die Fakes natürlich dadurch, dass Filmtrailer eh aus kurzen, schnell geschnittenen Sequenzen bestehen bei längeren Einstellungen als ein paar Sekunden würden KI-Darstellungsfehler, vor allem bewegter Objekte, oder andere Inkonsistenzen immer wahrscheinlicher.

// Top-News auf einen Blick:

- Blackmagic DaVinci Resolve 20 Beta 2 bringt neue Funktionen und Bugfixes

- Blackmagic Camera for Android 2.1 bringt neue Features

- Neuer superschneller PoX Flash-Speicher könnte DRAM und SSDs ersetzen

- Achtung: Verpixelte Videos können wieder kenntlich gemacht werden

- KI-generierte Fake-Trailer: Wie Hollywood an der Irreführung der Zuschauer ...

- Beleuchtung für Foto und Video lernen mit kostenlosem Tool von Google

Die Studios dulden und profitieren

Warum aber unternimmt das sonst so klagefreudige Hollywood-Studio nichts gegen diese Fakes? Das Filmmagazin Deadline hat die Antwort gefunden: Einmal auf die Fälschungen aufmerksam gemacht, entschieden sich Warner Bros. Discovery, Paramount und Sony Pictures dafür, die Fake-Trailer selbst zu monetarisieren und so Geld dafür zu bekommen, anstatt sie von YouTube entfernen zu lassen.

Sehr zum Ärger der US-Schauspieler-Gewerkschaft, die dafür kämpft, dass KIs Schauspieler nicht arbeitslos machen und sich im letzten Arbeitskampf erfolgreich von den Studios zusichern ließ, Schauspieler vor dem Einsatz ihrer per KI zum Leben erweckten Abbilder um Erlaubnis zu fragen und sie an den Einnahmen zu beteiligen. Durch die Monetarisierung der Fake-Trailer passiert genau das, was sie verhindern wollten: Per KI animierte Schauspieler generieren Geld für die Filmstudios, ohne dass die Originale dafür entlohnt werden (ganz davon abgesehen, dass sie gegen ihren Willen eingesetzt werden).

Schwer zu verstehen ist es, dass die Hollywood-Studios die Einnahmen anscheinend als so lukrativ ansehen, dass sie bereit sind, dafür eventuelle Imageschäden in Kauf zu nehmen, wenn potenzielle Kinogänger durch die schlecht gemachten Trailer vom Kinobesuch abgeschreckt werden.

Demonetarisiert - aber nicht gebannt

Inzwischen hat YouTube allerdings auf den Bericht von Deadline reagiert und die entsprechenden Kanäle demonetarisiert, d.h., es wird aufgrund des Verstoßes gegen die Nutzungsbedingungen keine Werbung mehr eingebunden und auch kein Geld mehr ausgeschüttet. Interessanterweise produzieren beide Kanäle noch weiter, zum Teil kennzeichnen sie die Trailer jetzt als "Konzept" sie hoffen anscheinend auf einen erfolgreichen Widerspruch.

Ärgerlich ist allerdings, dass YouTube die KI-Fakes online lässt, ohne die Zuschauer darauf hinzuweisen, dass es sich um KI-Schöpfungen handelt und sie so in die Irre führt. Schon oft haben verärgerte Zuschauer die Fake-Trailer-Kanäle gemeldet, aber keine Reaktion von YouTube bekommen. Warum auch? YouTube verdient selbst prächtig damit.