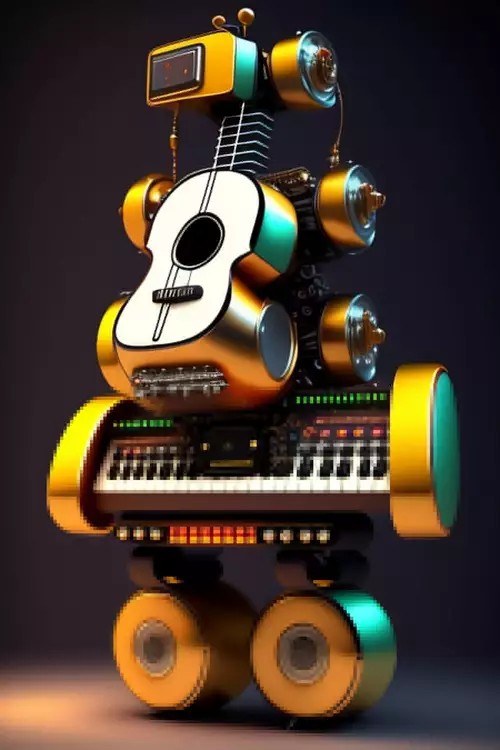

Nach der Generierung beliebiger Bilder und Videos mittels einer einfachen Textbeschreibung kommt jetzt der nächste logische Entwicklungsschritt - die Erzeugung beliebiger 3D-Modelle. Die neue, von Google entwickelte und "DreamFusion" getauft Methode basiert ebenfalls auf einem vortrainierten 2D-Text-Bild-Diffusionsmodell (wie etwa Googles Imagen oder Stablility.ais Stable Diffusion) und generiert nach einer einfachen Textbeschreibung 3D-Objekte, welche aus jedem beliebigen Winkel betrachtet, neu beleuchtet oder in eine 3D-Umgebung integriert werden können.

Implizit war auch schon bei den 2D-Bildern der bildgenerierenden KIs klar, daß diese nur anhand des Trainings mittels Milliarden von Bildern samt begleitender Textbeschreibung eine Art Verständnis vom dreidimensionalen Raum und den Objekten darin entwickelt hat. Per DreamFusion lassen sich mithilfe dieses Wissens jetzt gezielt einzelne 3D-Objekte erzeugen. Der Ansatz von DreamFusion erfordert deshalb keine expliziten 3D-Trainingsdaten und keine Änderungen am Bilddiffusionsmodell. Die generierten NeRF (Neural Radiance Field)-Modelle können (per Marching-Cubes-Algorithmus) in 3D-Meshes exportiert werden, welche dann leicht in 3D-Renderern oder einer 3D-Modellierungssoftware genutzt werden können.

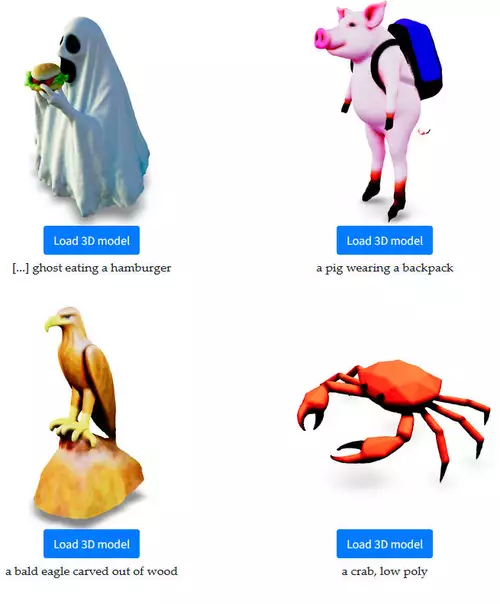

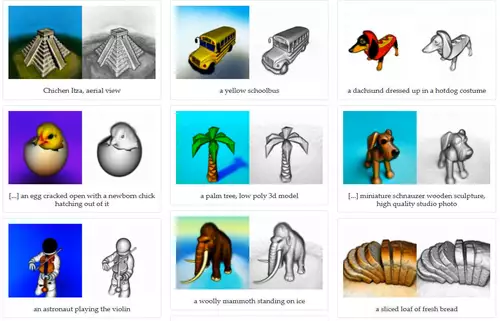

DreamFusion kann nicht nur ein beliebiges Objekt erzeugen, sondern es auch eine Handlung ausführen lassen oder mit einem weiteren Objekt (z.B. einem Kleidungsstück) kombinieren (wie etwa "ein Geist, der einen Hamburger isst" oder "ein Schimpanse, der wie Heinrich VIII., König von England, gekleidet ist").

// Top-News auf einen Blick:

- Blackmagic DaVinci Resolve 20 Beta 2 bringt neue Funktionen und Bugfixes

- Blackmagic Camera for Android 2.1 bringt neue Features

- Neuer superschneller PoX Flash-Speicher könnte DRAM und SSDs ersetzen

- Achtung: Verpixelte Videos können wieder kenntlich gemacht werden

- KI-generierte Fake-Trailer: Wie Hollywood an der Irreführung der Zuschauer ...

- Beleuchtung für Foto und Video lernen mit kostenlosem Tool von Google

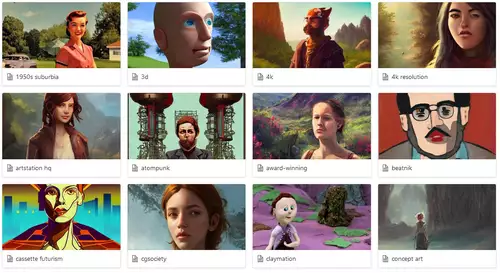

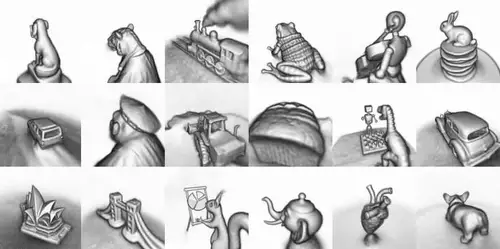

Wie auch schon bei den 2D-Bildgenerierungs-KIs ist es auch hier möglich, mittels eines Prompts mehrere Ergebnisse zu erzeugen - zudem kann der Algorithmus leicht auf die gleichzeitige Generierung mehrerer 3D-Modelle erweitert werden. Es gibt auch schon eine offizielle Online-Galerie mit hunderten von per DreamFusion erzeugten 3D-Modellen.

Die Chance, so einfach komplexe 3D-Modelle beliebiger Objekte zu erzeugen wird viele Anwendungsmöglichkeiten vereinfachen oder auch neu eröffnen. Der nächste logische Schritt ist dann die einfache Animation dieser Modelle und die gezielte Modifikation einzelner Eigenschaften der generierten Objekte.

Leider hat Google (noch) nicht den zugehörigen Code für DreamFusion veröffentlicht oder einen öffentlichen Zugang zu dem Modell bereitgestellt. Daher gibt es noch keine Möglichkeit für User, selbst 3D-Modelle zu generieren, aber findige Entwickler haben bereits angefangen, die Idee hinter DreamFusion per Stable Diffusion als offenes Projekt mit dem Namen Stable-Dreamfusion als Open Source Projekt umzusetzen.