Nachdem unserer Grundlagen-Artikel "Heller, aber wie bitte?" vor geraumer Zeit auf die zahlreichen Möglichkeiten einer Helligkeitskorrektur eingegangen ist, wollen wir uns diesmal grundlegend mit der Frage befassen, wie man eigentlich richtig die Sättigung eines Clips einstellen kann.

Sättigung nicht standardisiert?

Die auf den ersten Blick triviale Antwort führt uns direkt zu dem Sättigungs Regler im Programm. Und damit zu einem Twitter-Feed von Tim Soret, den Stu Maschwitz von Red Giant mit den Worten empfahl: "This is why Magic Bullets saturation controls look so much more natural than Adobes and others. Youll give away all our (completely open and obvious) secrets!"

In diesem Twitter-Feed wird beschrieben, warum eine Entsättigung in Photoshop meistens unnatürlich aussieht. Kurz zusammengefasst geht es dabei darum, dass sich die Helligkeitswerte der einzelnen Farben bei der Transformation nach Schwarz/Weiß verändern. Der Grund hierfür ist darin zu suchen, dass das menschliche Auge auf die unterschiedlichen Wellenlängen des Lichts nicht gleich empfindlich reagiert.

Der Autor kommt dabei in seinen Berechnungen auf folgendes Verhältnis, der "Empfindlichkeiten": Red 21% + Green 72% + Blue 7%. Das ganze erinnert ein bisschen an die Luminanz Umrechnungsformel von RGB nach YUV:

Y = 29,9% Rot + 58,7% Grün + 11,4% Blau.

Wenn auch mit leicht unterschiedlichen Verhältnissen erklären uns sowohl der Autor als auch die Wikipedia, dass "Grün heller wahrgenommen wird als Rot, dieses wiederum heller als Blau". Doch berücksichtigen professionelle Schnittsysteme dies nicht automatisch? Und sollte dies nicht selbstverständlich "perfekt" implementiert sein? Diese Fragen haben natürlich unser Interesse geweckt, weshalb wir gleich mal in Resolve und in Premiere die Sättigungsregler näher ausprobiert haben.

Die perfekte Entsättigung

Als erstes können wir gleich einmal Entwarnung geben. Weder in Resolve noch in Premieres Lumetri Abteilung findet sich eine derart "unsensible" Sättigungsfunktion wie in Photoshop. Stu Maschwitz´s Secrect Sauce der eigenen Produkte ist somit ebenso in Premiere und Resolve zu finden.

Aber bei der näheren Analyse ist uns dann noch noch ein interessantes Detail aufgefallen. Der Blick auf den Waveform Monitor kann nämlich deutlich zeigen, wie gut die Sättigungsfunktion an den eingestellten Farbraum angepasst ist. Und dies zeigte uns wiederum: In allen unseren Testfällen arbeitete die Sättigungsfunktion unabhängig vom Farbraum.

Dazu nochmal ein kurzes Gedankenspiel: Wenn man ein Bild entsättigt, so sollte sich die wahrgenommene Helligkeit von dem Bild mit Farben im besten Fall überhaupt nicht unterscheiden. Wenn wir das Bild im YUV-Farbraum betrachten, dann sollten durch den Sättigungsparameter nur die U- und V-Komponenten verändert werden. Y sollte dagegen für jedes Pixel gleich bleiben. Ansonsten wurde die Sättigung nach der per Definition ja nicht korrekt ausgeführt.

Und eben dies kann man deutlich analysieren, wenn man im Waverform-Monitor das Luma (also Y-)Signal genauer betrachtet. Dieses sollte sich bei einer Veränderung am Sättigungsregler nämlich im korrekten Fall überhaupt nicht verändern.

In der Praxis nie perfekt

In der Praxis bemerkt man jedoch fast immer eine leichte Luminanz-Verschiebung, zumindest in den Mitten. Dies ist noch nicht unbedingt ein Zeichen für ein schlechtes Color-Management. Doch im idealen Fall sollte der Sättingsregler seine Berechnungsformel an das genutzte Color Management anpassen, um exakt zu funktionieren. Das macht jedoch unseres Wissens nach jedoch kein Grading- oder Schnittprogramm.

Solange man den Sättigungs Regler zum Entsättigen benutzt, wird solche Nuancen kaum jemand bemängeln. Problematischer sieht es jedoch in der anderen Richtung aus. Denn wenn man die Sättigung erhöht, sollte sich eine nicht exakte Luminanz-Umrechnung theoretisch in Farbverschiebungen zeigen.

Nun sind Grader die Arbeitsweise der Sättigungs-Funktion ihres Grading-Programms gewohnt und passen gestättigte Farben meist in einer sekundären Maske sowieso noch an den Bällen oder per Hue manuell an. Dennoch könnte es interessant sein, mit einer exakten Sättigungsfunktion zu arbeiten.

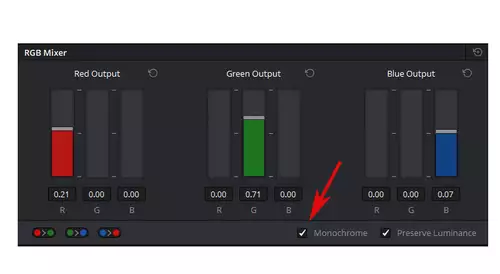

Hierfür könnte man versuchen seine Sättigungsfunktion über eigene Formeln an den Projekt Workflow anzupassen. In Resolve beispielsweise mit einer manuellen YUV-Wandlung im RGB-Mixer:

Jedoch merkt man auch hier schnell, dass eine hundertprozentige Wandlung nicht funktioniert, solange man nur mit ganzzahligen Werten an Schiebereglern herumprobieren kann. Ein exakter Workflow könnte vielleicht mit DCTLs gelingen, jedoch wollte uns dies in ein paar kurzen Experimenten nicht gelingen.

Individuelle Luma-Wandlung nutzen

Doch in der Praxis kann man dieses Wissen noch auf andere Weise nutzen, indem man die individuelle Luma-Wandlung produktiv einsetzt. Um die Zusammensetzung der Helligkeit nutzbar zu machen machen muss man diese "absplitten". In Resolve funktioniert dies beispielsweise, indem man mit einem Node-Layer arbeitet, der mit einem Überblendungsmodus gemapped wird.

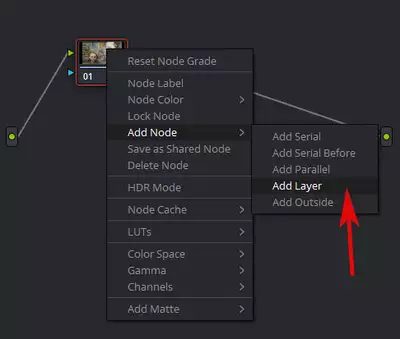

Hierfür klickt man in den Compositing-Layers auf "Add Node/Add Layer":

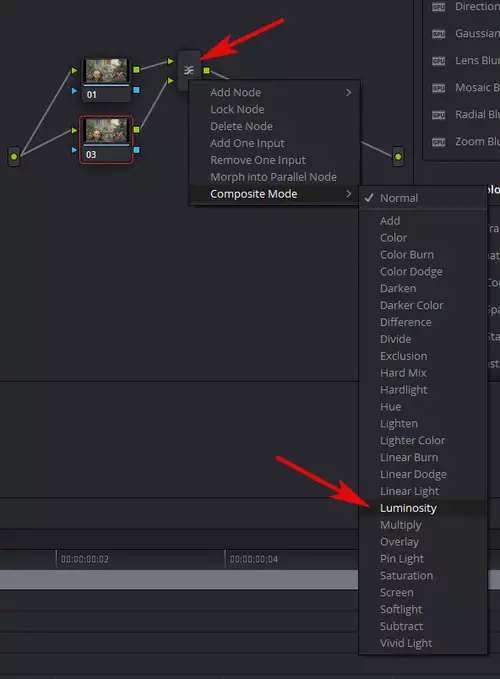

Anschließend wählt man im automatisch erstellten Mixer-Node als Composite-Mode "Luminosity":

Nun erzeugt der neue, untere Layer den Lumakanal, während der ursprüngliche, erste Node für die Farben zuständig bleibt.

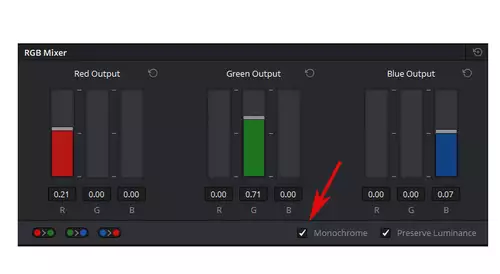

Somit kann man abschließend den neuen Node nutzen um in diesem mit dem RGB-Mixer die Zusammensetzung des Luma-Kanals zu definieren. Hierfür muss sinnvollerweise der Monochrome-Haken gesetzt sein, damit man seine Helligkeit aus den RGB-Komponenten zusammen mixen kann:

Interessanter Randaspekt: Regelt man nun im Chroma-Node die Sättigung stark hoch oder runter, so kann dies in manchen Fällen im Histogramm etwas besser als der einfache Sättigungsregler funktionieren, weil der Luma-Kanal ja nun explizit aus der Berechnung herausgehalten wird. Doch selbst mit dieser Methode kann es je nach Color-Management-Settings noch zu leichten Verschiebungen kommen.

Eigentlich könnte man sich diese Arbeit sowieso komplett sparen, wenn Colorgrading-Programme die Formel für diese einfache Sättigungs Funktion automatisch korrekt anpassen würden. Zumal die Hersteller an anderen Stellen ja immer gerne auf ihre hohe Präzision verweisen. Aber so einfach scheint die Sache vielleicht gar nicht zu sein...