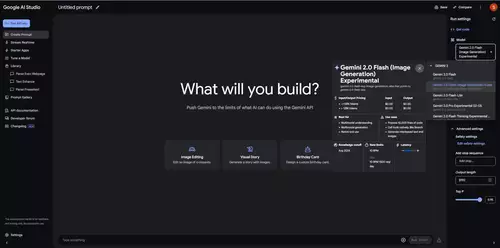

Wäre es nicht praktisch, Bilder einfach per Textbefehl editieren zu können und so auch komplexe Bearbeitungen ganz simpel durchführen zu können? Genau das ermöglicht Googles neuestes KI-Modell Gemini 2.0 Flash (Image Generation) Experimental, denn es können damit nicht nur Bilder in wenigen Sekunden generiert, sondern auch beliebige Bilder hochgeladen und per Text-Prompt objektorientiert bearbeitet werden. Das funktioniert, weil es ein multimodales Modell ist, d.h. es "versteht" Bilder und Texte und kann so komplexe Prompts korrekt interpretieren und mit den Bildinhalten in Verbindung bringen.

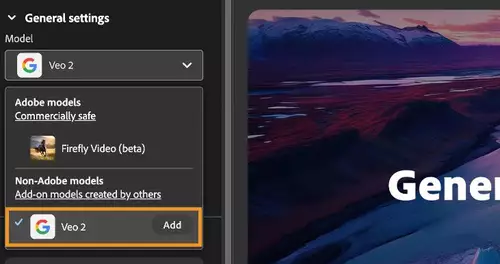

Und das Schönste: Man kann es selbst kostenlos im Browser nutzen über Googles AI Studio (https://aistudio.google.com/prompts/new_chat?model=gemini-2.0-flash-exp) - man wählt einfach in der rechten Leiste "Gemini 2.0 Flash (Image Generation) Experimental" aus und kann dann in der mittleren Spalte per Prompt ein neues Bild erschaffen bzw. wenn man ein eigenes dort per Drag & Drop ablegt, mittels eines Prompts verändern.

Viele Möglichkeiten der Bearbeitung per KI

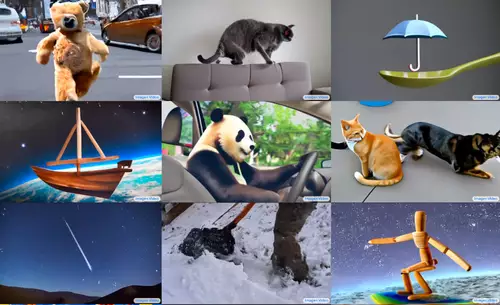

Die Möglichkeiten sind dabei, dank der generativen Macht von Gemini im Hintergrund, riesig: So lassen sich nicht nur gezielt Objekte spurlos aus dem Bild entfernen, sondern auch hinzufügen. Und da die Bearbeitung einfach per Beschreibung funktioniert, muss nicht mühsam mit der Hand per Maske ein Objekt markiert werden, sondern es reicht, das gewünschte Objekt sei es ein konkreter Gegenstand oder auch ein Bildelement wie der Hintergrund im Prompt zu erwähnen. So kann zum Beispiel auch einfach ein Wasserzeichen aus einem Bild entfernt werden - spurlos.

Und es gibt auch viele weitere Möglichkeiten: So kann ein Objekt im Bild per Prompt gezielt verändert werden und zum Beispiel dessen Farbe geändert werden oder sein Aussehen, wie zum Beispiel die Haarfarbe, Frisur, Kleidung, Körperhaltung oder der Gesichtsausdruck.

Es lassen sich auch zwei Bilder auf eine definierte Weise kombinieren. So kann zum Beispiel einer Person aus einem Photo ein Gegenstand aus einem zweiten Photo in die Hand gegeben oder auch ein exaktes Kleidungsstück ersetzt werden.

Man kann einfach alte schwarz-weiße Photos kolorieren:

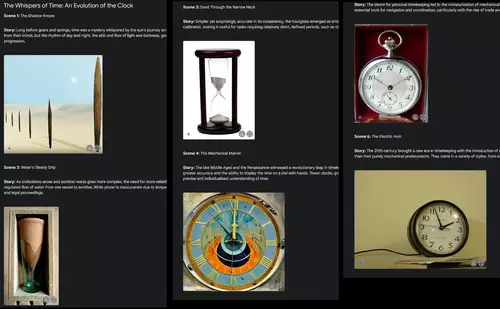

Es ist auch möglich, die Bildererstellung in einem Chat mit Gemini 2.0 zu nutzen und so die KI-Antworten auf eigene Fragen durch passende Bilder ergänzen lassen, quasi zur ergänzenden Bebilderung, hier zum Beispiel die Evolution der Uhr:

// Top-News auf einen Blick:

- Blackmagic DaVinci Resolve 20 Beta 2 bringt neue Funktionen und Bugfixes

- Blackmagic Camera for Android 2.1 bringt neue Features

- Neuer superschneller PoX Flash-Speicher könnte DRAM und SSDs ersetzen

- Achtung: Verpixelte Videos können wieder kenntlich gemacht werden

- KI-generierte Fake-Trailer: Wie Hollywood an der Irreführung der Zuschauer ...

- Beleuchtung für Foto und Video lernen mit kostenlosem Tool von Google

Ein klassisches Problem anderer generativer Modelle scheint auch gelöst: Gemini 2.0 kann auch längere Texte in Bildern korrekt darstellen.

Die Liste der praktischen Anwendungsfälle ist damit aber noch lange nicht am Ende: so kann man zum Beispiel auch einen Gegenstand aus einem Bild freistellen, etwa als Product-Shot; testen, wie neue Möbel im eigenen Zimmer aussehen würden; ebenso neue Kleidung anhand eines eigenen Photos anprobieren und noch viel mehr...

Konsistenz

Eine weitere Besonderheit des neuen Modells ist die Fähigkeit, Objekte über mehrere Bilder konsistent darzustellen, jeweils in einem anderen Kontext oder aus einer anderen Perspektive oder einem anderen Zustand. So können zum Beispiel einfach Bildserien oder Stories erstellt werden. Allerdings leidet die Objektkonsistenz, wenn man es in einer ganzen Befehlskette immer weiter bearbeitet, wie im folgenden Beispiel:

Lol, the new image editing features in Google&s Gemini model are AMAZING. But they do have their limits pic.twitter.com/4RgjhyNga2

kvick (@kvickart) March 12, 2025

Das neue Gemini-Modell ist allerdings noch experimentell, d.h. es kann beeindruckende Sachen machen, aber die Auflösung ist mit 1.024 x 673 Pixeln recht gering, es kommt auch manchmal zu Bildfehlern und nicht immer werden die Prompts korrekt interpretiert, aber wie immer in Sachen KI gilt: "it&s a work in (fast) progress".

Hier noch mehr Beispiele:

Google&s Gemini 2.0 Flash Experimental model allows you to generate and edit images by just talking to it using natural language. I&ve been thoroughly testing it and the amount of use cases are blowing my mind!

Travis Davids (@MrDavids1) March 14, 2025

I&ve prepared 12 creative use cases for you to try

All pic.twitter.com/ckstMsuC7w

Gemini dropped their truly multimodal in/out image generator.

Bilawal Sidhu (@bilawalsidhu) March 12, 2025

Been on the EAP, here are my thoughts + some tips & tricks for "conversational image editing"

Bookmark this, and try it later for free in google AI studio.

Let&s get into it: pic.twitter.com/7nd59PdE8b

1. Basic image editing pic.twitter.com/uwLetCASpk

AI Andy (@TheAIAndy) February 6, 2025